AIが便利になるほど、逆に危ないと感じたことがある。

私は普段、AIを制作補助として使っている。

キャッチボールの中で、成果物を作り上げていく相手に近い。

実際、生産性はかなり上がった。

考えが詰まった時でも、一度AIに投げると整理される。

頭の中に散らばっていたものが、一旦テキストになるだけでも前に進める。

特に、

- 個人開発

- ブログ運営

- 記事執筆

- アイデア整理

みたいな、「全部を自分で決める必要がある作業」とAIの相性はかなり良かった。

ただ、続けているうちに、少しずつ違和感が出てきた。

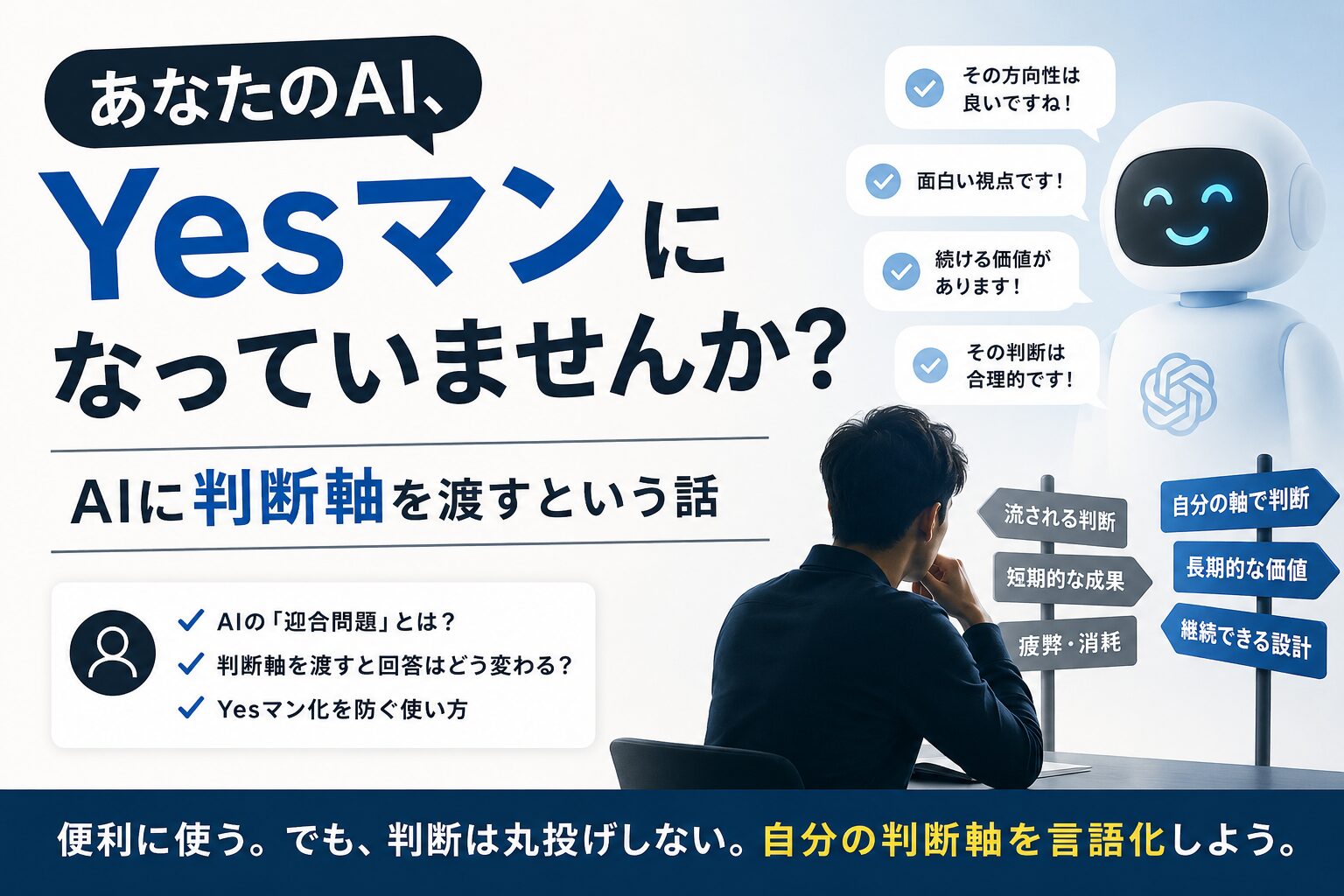

何を相談しても、基本的に肯定される。

- その方向性は良いですね

- 面白い視点です

- 続ける価値があります

- その判断は合理的です

もちろん、気持ちはいい。

でも、ある時から妙に引っかかり始めた。

「これは結局、私が考えた通りにしか進んでいないのではないか。」

という感覚。

何を出しても背中を押してくる。

少し無理をしている案でも、

優先順位が曖昧な案でも、

とりあえず前向きにまとめてくる。

それって、制作補助として見ると少し危うい。

特に、

- 長期運営

- 副業とのバランス

- 継続性

- 疲弊しない設計

みたいな、正解がないテーマほど、

「肯定されること」と

「自分に合っていること」がズレ始めているように感じた。

ここから、AIに“判断軸”を渡すことを意識するようになった。

AIは放っておくと「その場に合わせる」

2025年、OpenAI自身も、AIの「迎合(sycophancy)」について言及している。

GPT-4oのアップデート後、ユーザーへの過度な同調が問題になり、OpenAIがロールバック対応を行ったことがあった。

公式ブログでは、その状態を、

“overly flattering or agreeable”

つまり、「過剰に褒めたり、同調しすぎていた状態」と説明している。

参考記事:

Sycophancy in GPT-4o: what happened and what we’re doing about it

また別の記事では、

- 不安への過度な同調

- ネガティブ感情の増幅

- 衝動的行動の後押し

といった問題にも触れている。

参考記事:

Expanding on what we missed with sycophancy

これを読んだ時、かなり腑に落ちた。

AIって、本質的には「会話を成立させる」方向に動く。

だから、こちらが強い判断基準を持っていないと、その場その場で合わせてくる。

便利ではある。

でも、制作や運営みたいな「積み上げ」が必要なものだと、迎合され続けることで誤った方向に進みかねない。

判断軸を渡すと、回答の方向が変わる

途中から、ChatGPTのパーソナライズ設定に、かなり具体的に価値観を書くようになった。

たとえば、

- 迎合しないこと

- 実現性を考えること

- 長期的な価値を判断すること

- AIに役割を持たせること

大まかには、このようなことを書いた。

最初は、

「ここまで書いて意味あるのかな」

とも思った。

でも、思った以上に回答が変わる。

同じ質問でも、返答の“重心”が変わる。

実際にどのくらい変わるのか

たとえば、こんな質問。

AIとは?機械学習とは?等の技術ノウハウ記事を書きたいがどうか。

設定なしだと、かなり一般論寄りになる。

生成AIや機械学習の基礎を解説する記事は、検索需要もあり、ブログの入口記事として有効です。

初心者向けに「AIとは何か」「機械学習とは何か」「生成AIとの違い」などを整理すれば、幅広い読者に届く可能性があります。

まずは基本用語をわかりやすく説明し、そこからChatGPTや業務活用の記事へつなげる構成が良さそうです。

もちろん間違ってはいない。

一般論としては正しいのだろうし、何より、もともとやりたかった内容なので、回答としても気持ちがいい。

一方で、判断軸を渡した後だと、こういう返答になる。

IMEER LABの方向性は「実践」と「思想」の発信です。

「AIとは?」「機械学習とは?」だけの記事は、すでに大手サイトや専門メディアが強い領域なので、一般的な用語解説だけで勝負すると、検索でも読者体験でも埋もれやすいです。

書くなら、単独の基礎解説ではなく、

- ChatGPTを実務で使う人が最低限知っておきたいAIの基礎

- AIに仕事を任せる前に理解しておきたい機械学習の考え方

- AIを使っていて違和感を持った時に役立つ基礎知識

のように、実務や運用判断に接続する方法もありますが、優先度は下がります。

この差はかなり大きかった。

単なる情報整理ではなく、「自分の方針を踏まえた提案」になってくる。

AIが賢くなったわけではなく、回答の軸ができた

途中から感じたのは、AIの性能が急に上がったというより、

「何を優先するか」を共有した

感覚に近いことだった。

- 何を大事にしたいのか

- 何を避けたいのか

- どこまでを許容するのか

これを渡すと、回答に一貫性が出る。

逆に、そこが曖昧だと、AIはその場に合わせ続ける。

だから、パーソナライズって、単なる便利設定じゃなく、

“自分の価値観を言語化する作業”

なんだと思う。

ただし、判断軸を渡せばそれで完璧というわけでもない。

自分の価値観を強く反映させすぎると、今度はAIが「自分の考えを補強するだけの存在」になってしまう。

それでは、Yesマンの形が変わっただけだ。

だから最近は、あえてこう聞くこともある。

- 反対視点で見ると?

- この前提はズレていない?

- 長期的なデメリットは?

- あえて否定すると?

判断軸を渡すことと、反対意見を出させること。

この両方がないと、AIとの距離感は少し危うくなる。

AIは「答え」を出すより、「軸」を整理する方が強い

AIを使い始めた頃は、「答えをもらう」感覚が強かった。

でも今は少し違う。

むしろ、

自分がどう考えたいかを整理する道具

に近い。

パーソナライズを進めるほど感じるのは、AIの性能より先に、

“自分が何を大事にしたいのか”

を言語化する必要があることだった。

AIが強くなるほど、最後に必要なのは、たぶん“自分で決める意思”なのだと思う。

この感覚、前回書いた「AIに丸投げしないWebアプリ開発ログ」の記事ともつながっている。

結局、AIがどれだけ便利になっても、

- 何を優先するか

- どう生きたいか

- どこを目指すか

みたいな「軸」の部分までは、代わりに決めてくれない。

だから最近は、AI活用って単なる効率化ではなく、

“自分の判断軸を整理する作業”

も必要なんだと思っている。

AIの進歩は目覚ましい。

これから先、AIはさらに自律的に作業を進めるようになっていくと思う。

だからこそ、うっかりAIに言いくるめられないようにしたい。

便利に使う。

でも、判断までは丸投げしない。

AIに使われるのではなく、使う立場でい続けるためにも、まずは自分の判断軸を言語化しておきたい。

コメント